I build fullstack AI driven products

Hi, I'm Juan. Let's find robust solutions to your unique problems

Projects in the wild

Workflow

Alytic

Augmented analytics integration for Notion

Connect a Data Analist Agent to your Google Analytics and receive periodic reports in Notion

Agent

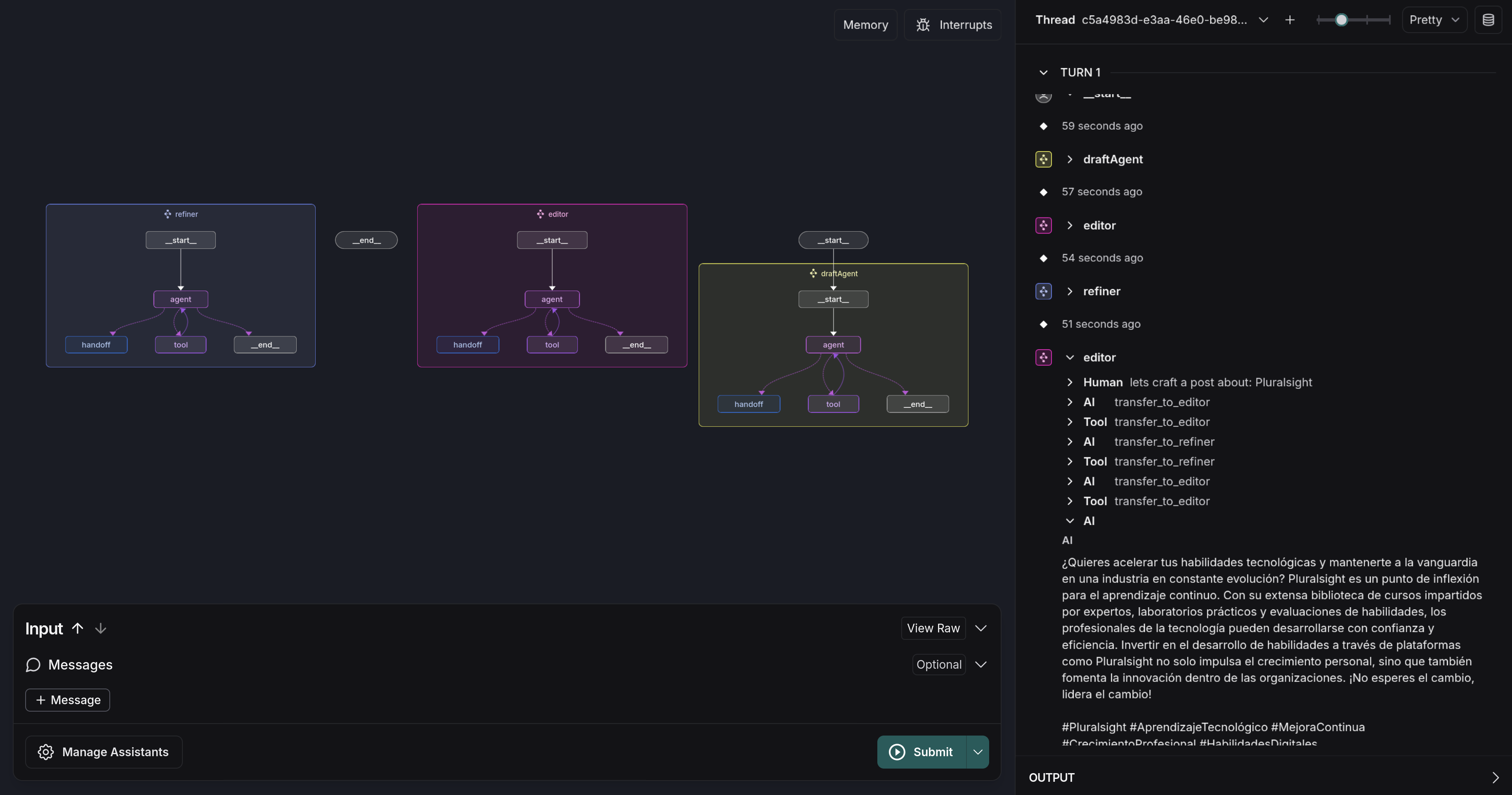

SoMe

A semi human in the loop swarm network.

A swarm network of agent to draft, refine and evaluate social media posts, it can post for the user.